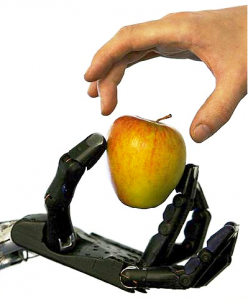

BOLOGNA – Braccia o mani robotiche che si muovono col pensiero? Sembra fantascienza, invece è un orizzonte che si avvicina e che potrebbe cambiare la vita a persone paraplegiche o tetraplegiche. Un primo passo per creare protesi robotiche ‘comandate’ direttamente dal cervello. I ricercatori del Dipartimento di Farmacia e Biotecnologie dell’Università di Bologna, infatti, sono riusciti a decodificare l’attività neurale che spinge una mano a muoversi per afferrare un oggetto: un primo passo per creare protesi robotiche azionate direttamente dal cervello. E i risultati delle ricerca sono stati pubblicati dalla rivista statunitense “The Journal of Neuroscience” in un articolo il cui primo autore è Matteo Filippini, giovane dottorando della Scuola di dottorato in Scienze biomediche e neuromotorie dell’Alma Mater, diretta dal professor Lucio Cocco. Quando gli occhi osservano un oggetto da prendere, il cervello dà vita ad una serie di complesse operazioni: per identificare e localizzare l’oggetto, per programmare l’azione giusta da compiere, e infine per dare inizio al movimento dell’arto. Tutti processi che vengono compiuti senza sforzo da individui normodotati, ma che non riescono ad attivare un movimento corretto negli individui con lesioni spinali, perché la lesione impedisce al segnale motorio di far muovere l’arto.

BOLOGNA – Braccia o mani robotiche che si muovono col pensiero? Sembra fantascienza, invece è un orizzonte che si avvicina e che potrebbe cambiare la vita a persone paraplegiche o tetraplegiche. Un primo passo per creare protesi robotiche ‘comandate’ direttamente dal cervello. I ricercatori del Dipartimento di Farmacia e Biotecnologie dell’Università di Bologna, infatti, sono riusciti a decodificare l’attività neurale che spinge una mano a muoversi per afferrare un oggetto: un primo passo per creare protesi robotiche azionate direttamente dal cervello. E i risultati delle ricerca sono stati pubblicati dalla rivista statunitense “The Journal of Neuroscience” in un articolo il cui primo autore è Matteo Filippini, giovane dottorando della Scuola di dottorato in Scienze biomediche e neuromotorie dell’Alma Mater, diretta dal professor Lucio Cocco. Quando gli occhi osservano un oggetto da prendere, il cervello dà vita ad una serie di complesse operazioni: per identificare e localizzare l’oggetto, per programmare l’azione giusta da compiere, e infine per dare inizio al movimento dell’arto. Tutti processi che vengono compiuti senza sforzo da individui normodotati, ma che non riescono ad attivare un movimento corretto negli individui con lesioni spinali, perché la lesione impedisce al segnale motorio di far muovere l’arto.

Ecco quindi la necessità di sviluppare interfacce cervello-macchina in grado di utilizzare direttamente l’attività neurale per azionare una protesi bypassando la lesione del midollo spinale. Per farlo però, è necessario registrare l’attività neurale del cervello e capire come decodificarla. I primissimi tentativi in questo senso sono partiti dieci anni fa negli Stati Uniti, utilizzando l’attività della corteccia motoria primaria, l’ultima stazione corticale che controlla i nostri muscoli volontari. Ora il gruppo di ricerca dell’Alma mater, guidato dalla docente Patrizia Fattori, ha però cambiato obiettivo e si è focalizzato sulla corteccia parietale posteriore. E ha avuto successo: gli studiosi sono riusciti infatti in questo modo a decodificare la configurazione della mano per afferrare oggetti diversi. “La regione corticale- spiega Fattori- non è una regione strettamente motoria, ma è fortemente coinvolta nell’esecuzione del movimento di avvicinamento e afferramento degli oggetti. I risultati dello studio dimostrano che l’attività usata per la decodifica neurale indica con chiarezza quale configurazione della mano verrà usata quando si afferra un oggetto con una specifica forma”. Ma i risultati della ricerca mostrano anche un cambio di codice tra il momento che precede il movimento dell’arto e il momento in cui viene afferrato l’oggetto. “Durante la visione dell’oggetto da prendere- spiega Rossella Breveglieri, altra docente Unibo coinvolta nello studio- i neuroni usano un codice ‘visivo’, che analizza le caratteristiche dell’oggetto, la sua forma e il suo orientamento nello spazio. Successivamente, i neuroni utilizzano invece un codice ‘motorio’ per poter correttamente configurare le dita e la mano in modo da riuscire a prendere l’oggetto”.

DIRe www.dire.it